Teil 3 einer dreiteiligen Analyse von Speicherdimensionierung und Leistungsauslegung unter realen Nachfragebedingungen

Zusammenfassung

In Teil 1 haben wir gezeigt, dass stochastische Planung die Verfügbarkeit bei gleichen Kosten verdreifacht. In Teil 2, was jeder Prozentpunkt Zuverlässigkeit kostet – und wo harte No-Go-Grenzen liegen. Beide Teile basieren auf vier parallelen Verbrauchern. Doch wie sensitiv sind die Ergebnisse gegenüber der Nachfragestruktur?

In diesem dritten Teil variieren wir systematisch die Anzahl der Verbraucher – und damit die Volatilität der aggregierten Nachfrage. Das zentrale Ergebnis: Es existiert ein robuster Auslegungsbereich, der unter allen getesteten Nachfrageszenarien stabile Kosten liefert. Die Verfügbarkeit verbessert sich mit wachsender Abnehmerzahl automatisch – ohne Mehrinvestition auf der Erzeugungsseite. Gleichzeitig wächst der Hebel der stochastischen Optimierung von Faktor 1,8 auf Faktor 17,8.

Sensitivität der Nachfragestruktur

Bevor wir die Verbraucheranzahl variieren, lohnt ein Blick auf die Sensitivität des Baseline-Modells aus Teil 1. Die vier Verbraucher sind stochastisch nahezu unabhängig – die paarweisen Korrelationskoeffizienten liegen bei maximal |r| = 0,085. Das ist kein Nebenaspekt: In der Realität können systemische Faktoren wie Produktionszyklen, saisonale Muster oder gemeinsame Stillstandszeiten Korrelationen erzeugen. Korrelierter Bedarf würde die Nachfragespitzen erhöhen und den Speicherbedarf weiter vergrößern. Die Unabhängigkeitsannahme stellt damit den konservativen Fall dar.

Die Sensitivitätsanalyse zeigt zudem: Der Wegfall eines einzelnen Verbrauchers reduziert den Jahresbedarf um 97 bis 116 t – das sind 40 bis 48 % des Gesamtverbrauchs. Der Sensitivitätskoeffizient von 0,031 bedeutet: Jeder Prozentpunkt zusätzliche Stillstandszeit in der Übergangsmatrix senkt den Gesamtbedarf um etwa 3,1 %. Die Nachfragestruktur ist also keine fixe Randbedingung, sondern selbst eine relevante Variable.

Genau das führt zur zentralen Frage dieses Teils: Was passiert, wenn wir die Nachfragestruktur systematisch verändern?

Nachfragevolatilität als Stellgröße

Wir wiederholen die gesamte Monte-Carlo-Analyse für 2, 4, 6, 8 und 12 parallele Verbraucher. Damit der Vergleich fair bleibt, wird der Gesamtverbrauch über alle Varianten auf einem vergleichbaren Niveau gehalten (~240 t/a): Mehr Verbraucher bedeutet kleinere Einzelabnehmer, nicht mehr Gesamtnachfrage. So isolieren wir den reinen Effekt der Nachfragevolatilität auf die optimale Auslegung.

Weniger Verbraucher bedeuten schärfere Nachfragespitzen; mehr Verbraucher glätten das Profil durch Überlagerung. Die Frage ist: Wie stark wirkt sich das auf die Auslegung und die Verfügbarkeit aus?

Stabile Kosten, skalierende Verfügbarkeit

Wir betrachten zunächst eine fixe Konfiguration – 3 MW Elektrolyseur-Leistung und 2 t Pufferspeicher – über alle Varianten:

| Verbraucher | Spez. CAPEX (3 MW + 2 t) | Nicht verfügbar | Std. (95 % KI) |

|---|---|---|---|

| 2 | 3,42 €/kg | 14,8 % | 1,19 pp |

| 4 | 3,43 €/kg | 6,2 % | 0,73 pp |

| 6 | 3,45 €/kg | 3,0 % | 0,49 pp |

| 8 | 3,46 €/kg | 1,7 % | 0,35 pp |

| 10 | 3,46 €/kg | 0,9 % | 0,26 pp |

| 12 | 3,46 €/kg | 0,6 % | 0,19 pp |

Die spezifischen Kosten bleiben praktisch konstant bei ~3,45 €/kg – unabhängig von der Anzahl der Verbraucher. Was sich ändert, ist ausschließlich die Verfügbarkeit: Von knapp 15 % Ausfallrate bei 2 Abnehmern auf 0,6 % bei 12 Abnehmern. Ohne einen Cent Mehrinvestition auf der Erzeugungsseite.

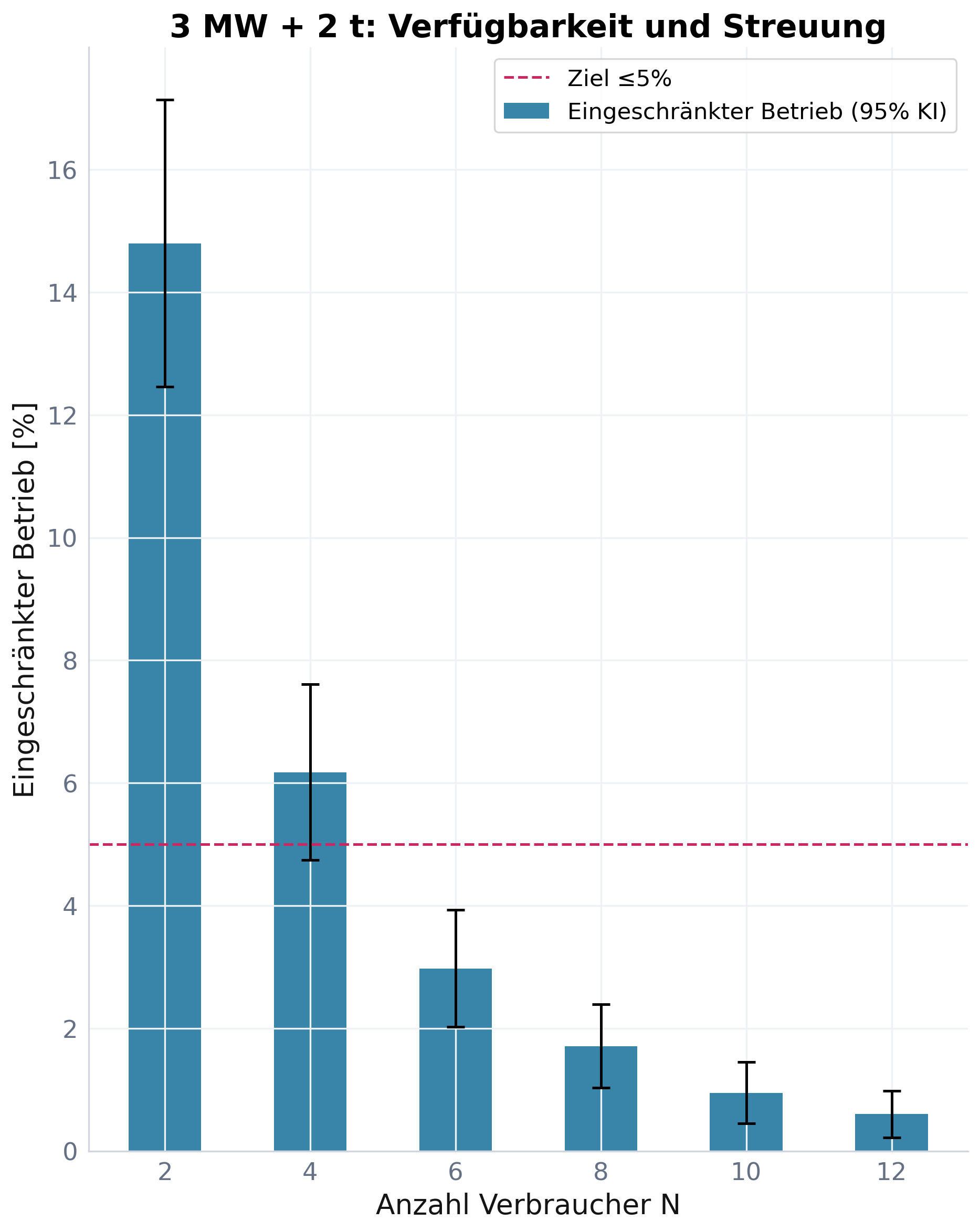

Abbildung 1: Eingeschränkter Betrieb bei der Konfiguration 3 MW + 2 t als Funktion der Verbraucheranzahl. Fehlerbalken zeigen das 95-%-Konfidenzintervall. Ab 6 Verbrauchern liegt die mittlere Ausfallrate unter der 5-%-Schwelle.

Abbildung 1: Eingeschränkter Betrieb bei der Konfiguration 3 MW + 2 t als Funktion der Verbraucheranzahl. Fehlerbalken zeigen das 95-%-Konfidenzintervall. Ab 6 Verbrauchern liegt die mittlere Ausfallrate unter der 5-%-Schwelle.

Ebenso bemerkenswert: Die Standardabweichung der Nicht-Verfügbarkeit sinkt von 1,19 auf 0,19 Prozentpunkte (95 %-Konfidenzintervall). Die Ergebnisse werden nicht nur im Mittel besser, sondern auch vorhersagbarer. Für einen Projektplaner heißt das: Die Prognose wird zuverlässiger, das Risiko sinkt – und zwar beides gleichzeitig, ohne dass man irgendetwas an der Erzeugungsseite verändert.

Der Grund ist ein Diversifikationseffekt: Unkorrelierte Verbraucher glätten die aggregierte Nachfrage. Die Spitzen werden relativ kleiner, die Verteilung wird schmaler, und der Pufferspeicher muss weniger extreme Schwankungen abfangen.

Gleiche Zielvorgabe, sinkende Kosten

Was bedeutet das für konkrete Verfügbarkeitsanforderungen? Die ≤5 %-Zielvorgabe über alle Varianten macht den Effekt besonders greifbar:

| Verbraucher | Leistung | Speicher | Spez. CAPEX |

|---|---|---|---|

| 2 | 3 MW | 4,8 t | 4,12 €/kg |

| 4 | 3 MW | 2,2 t | 3,48 €/kg |

| 6 | 3 MW | 1,6 t | 3,36 €/kg |

| 8 | 3 MW | 1,4 t | 3,32 €/kg |

| 10 | 3 MW | 1,3 t | 3,30 €/kg |

| 12 | 3 MW | 1,2 t | 3,28 €/kg |

Bei 2 Verbrauchern braucht man bei 3 MW knapp 5 t Speicher, um 5 % Ausfallrate zu erreichen – bei über 4 €/kg. Mit steigender Abnehmerzahl sinkt der benötigte Speicher stetig bei fallenden Kosten. Die Nachfrage wird so glatt, dass das System mit immer weniger Puffer auskommt.

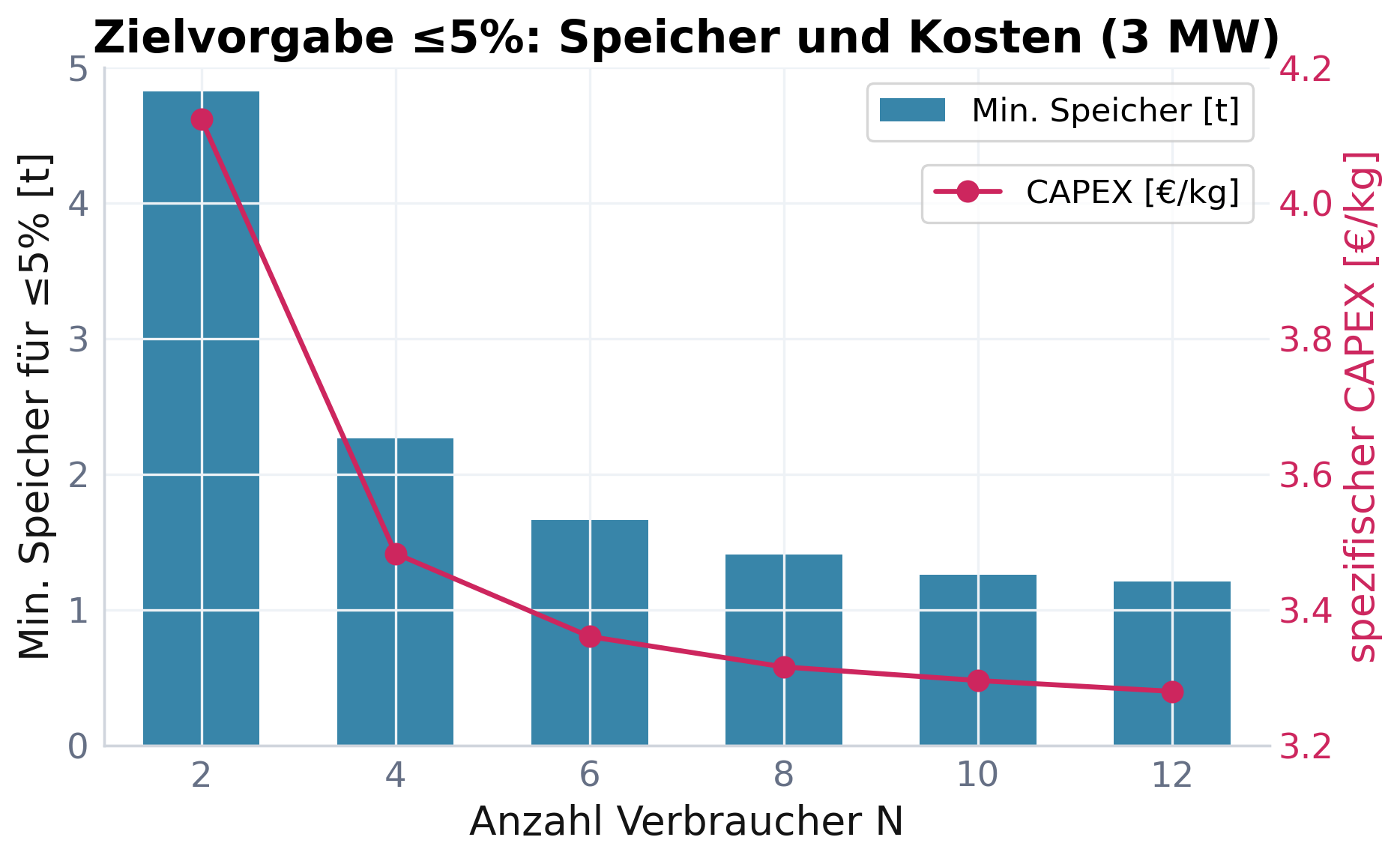

Abbildung 2: Speicherbedarf (Balken) und spezifischer CAPEX (Linie) für die Zielvorgabe ≤5 % eingeschränkter Betrieb bei 3 MW. Bei 8 Verbrauchern sinkt der Speicherbedarf auf unter ein Drittel gegenüber 2 Verbrauchern.

Abbildung 2: Speicherbedarf (Balken) und spezifischer CAPEX (Linie) für die Zielvorgabe ≤5 % eingeschränkter Betrieb bei 3 MW. Bei 8 Verbrauchern sinkt der Speicherbedarf auf unter ein Drittel gegenüber 2 Verbrauchern.

Das hat unmittelbare Konsequenzen für die Speicherdimensionierung: Die gleiche Verfügbarkeitsgarantie erfordert bei 8 Verbrauchern nur noch knapp ein Drittel des Speichers wie bei 2 Verbrauchern – bei 20 % niedrigeren spezifischen Kosten. Der Speicher, den man bei wenigen Abnehmern braucht, wird durch die Diversifikation überflüssig.

Der Hebel der Stochastik wächst mit der Diversifikation

Noch aufschlussreicher ist der Vergleich zwischen deterministischer und stochastischer Auslegung über die Varianten:

| Verbraucher | Ausfall deterministisch | Ausfall stochastisch | Faktor |

|---|---|---|---|

| 2 | 26,6 % | 14,8 % | 1,8× |

| 4 | 19,1 % | 6,2 % | 3,1× |

| 6 | 16,5 % | 3,0 % | 5,6× |

| 8 | 14,8 % | 1,7 % | 8,6× |

| 10 | 11,8 % | 1,0 % | 12,4× |

| 12 | 10,7 % | 0,6 % | 17,7× |

Je mehr Verbraucher, desto mehr Struktur steckt in der aggregierten Nachfrage – und desto mehr Potenzial kann die stochastische Optimierung ausnutzen. Bei 12 Verbrauchern ist der Unterschied fast Faktor 18. Deterministische Planung lässt dieses Potenzial vollständig auf dem Tisch.

Gleichzeitig zeigt sich eine Konvergenz: Der deterministische Ausgangswert sinkt mit steigender Verbraucheranzahl von 26,6 % auf 10,7 %. Die aggregierte Nachfrage wird zunehmend glatter, und die deterministische Betrachtung nähert sich der Realität an. Ab einer gewissen Systemgröße verliert die stochastische Modellierung ihren Zusatzwert – die Volatilität ist dann bereits durch die Nachfragestruktur selbst entschärft. Die Frage, ab wann dieser Punkt erreicht ist, hängt vom konkreten Projekt ab – und genau hier liegt der Wert der Analyse.

Wie die Diversifikation die Pareto-Front verschiebt

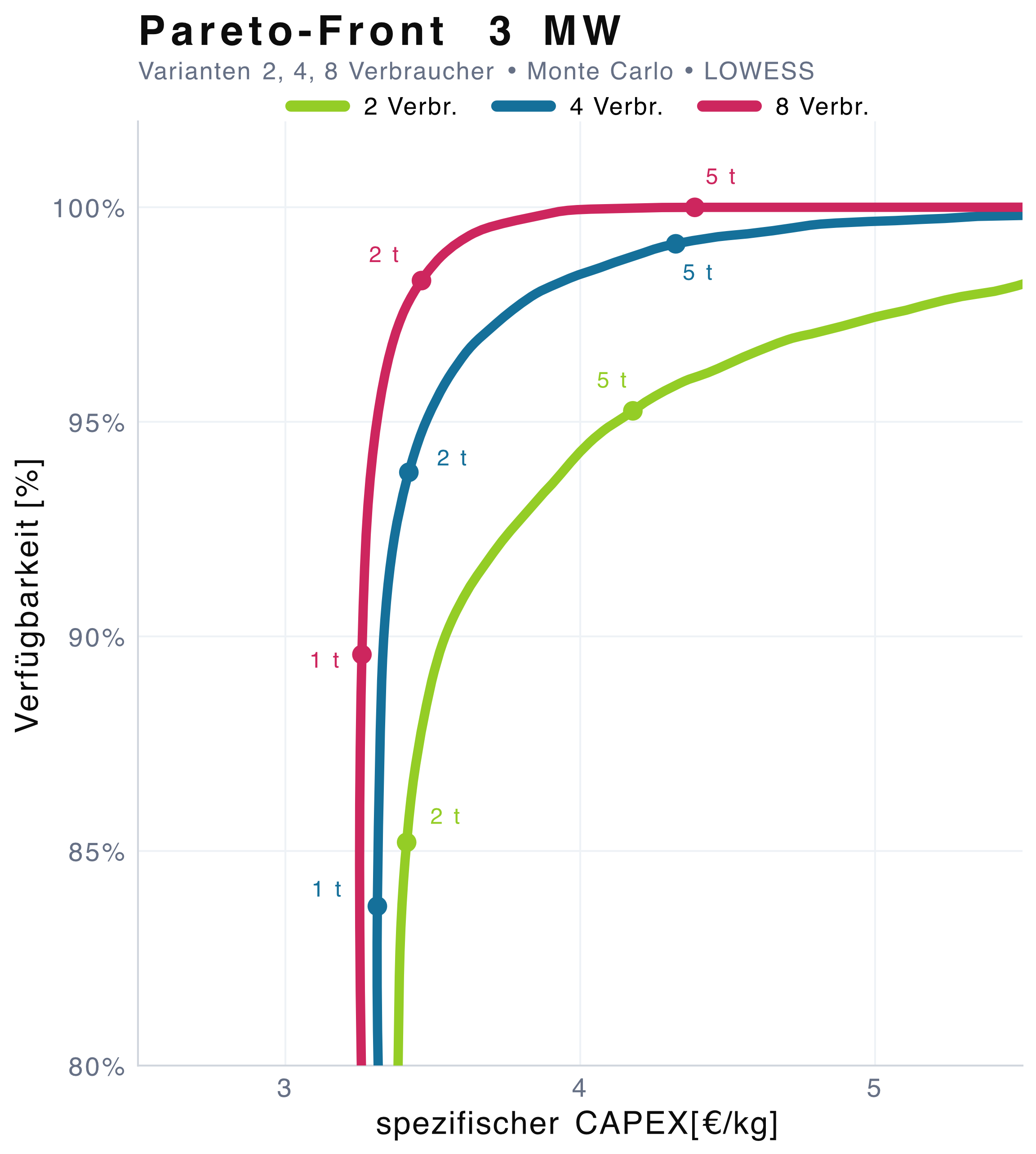

Die Auswirkung der Verbraucheranzahl zeigt sich besonders eindrücklich im direkten Vergleich der Pareto-Fronten. Für die 3-MW-Leistungsklasse verschiebt sich die gesamte Kurve mit steigender Verbraucheranzahl nach links – in den Bereich höherer Verfügbarkeit:

Abbildung 3: Pareto-Fronten der 3-MW-Konfiguration für 2, 4 und 8 Verbraucher. Annotierte Punkte zeigen Speichergrößen. Bei 8 Verbrauchern erreicht die Kurve bereits bei 2 t nahezu 98 % Verfügbarkeit – bei 2 Verbrauchern braucht man dafür über 5 t.

Abbildung 3: Pareto-Fronten der 3-MW-Konfiguration für 2, 4 und 8 Verbraucher. Annotierte Punkte zeigen Speichergrößen. Bei 8 Verbrauchern erreicht die Kurve bereits bei 2 t nahezu 98 % Verfügbarkeit – bei 2 Verbrauchern braucht man dafür über 5 t.

Bei 2 Verbrauchern steigt die Kurve im linken Bereich steil an – hohe Verfügbarkeit ist nur mit viel Speicher und entsprechend hohem CAPEX erreichbar. Bei 8 Verbrauchern dagegen flacht die Kurve deutlich ab: Die aggregierte Nachfrage ist bereits so glatt, dass der Speicher nur noch marginale Schwankungen puffern muss. Man nähert sich dem deterministischen Fall – und genau das erklärt die Konvergenz, die wir in der Faktor-Tabelle oben sehen.

Diversifikation als ICR-Hebel

In Teil 2 haben wir die Incremental Cost of Reliability (ICR) eingeführt – die Grenzkosten pro Prozentpunkt Verfügbarkeit. Die Diversifikation liefert eine verblüffende Ergänzung: Bei fixer Konfiguration (3 MW + 2 t) steigt die Verfügbarkeit mit der Verbraucheranzahl, ohne dass der CAPEX sich ändert.

In der Sprache der ICR: Diversifikation hat einen ICR von praktisch null. Jeder Prozentpunkt Verfügbarkeitsgewinn kostet nichts an zusätzlichem CAPEX.

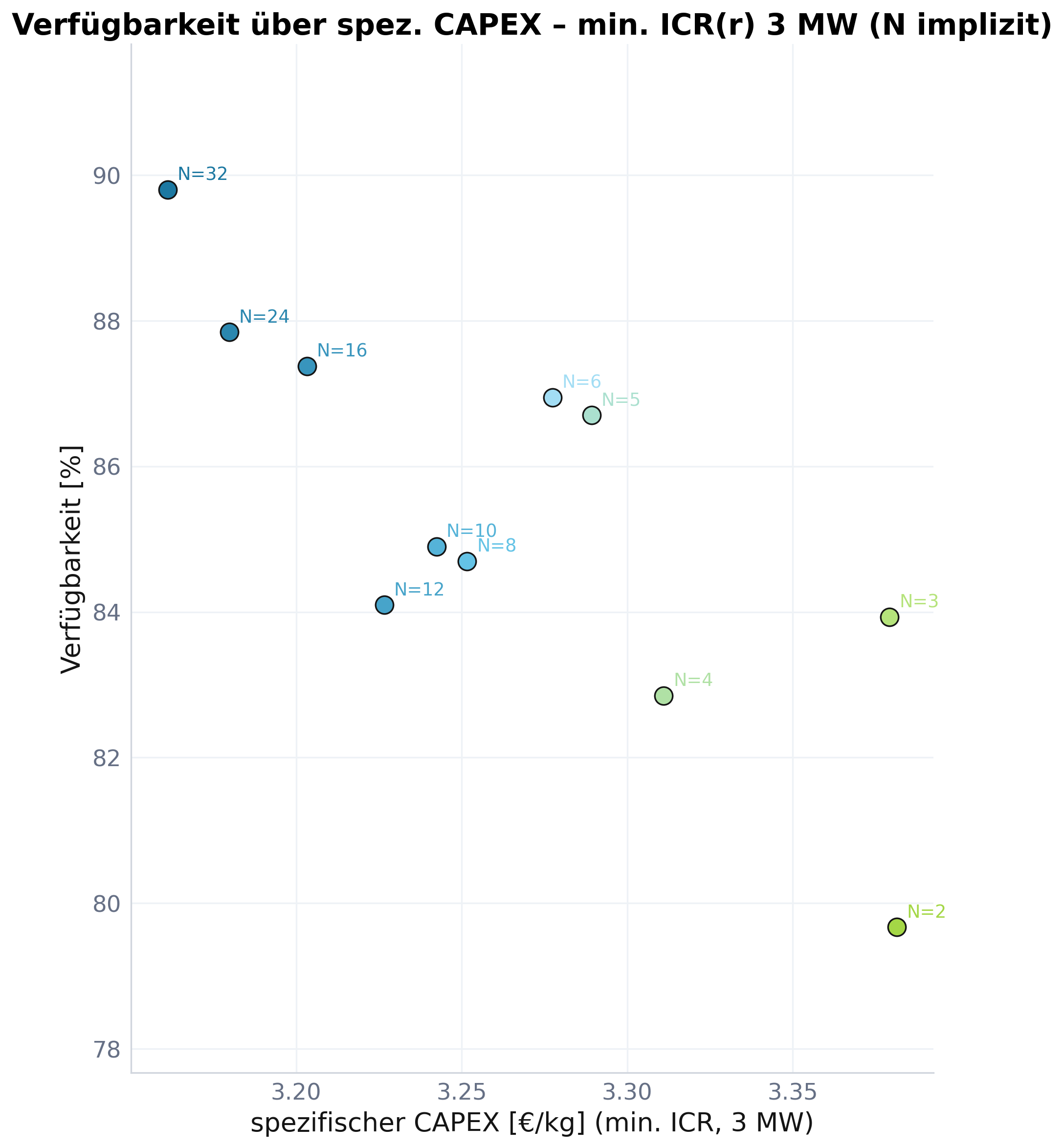

Abbildung 4: Verfügbarkeit über spezifischem CAPEX am Punkt minimaler ICR (3 MW). Jeder Punkt repräsentiert eine Verbraucher-Variante (N = 2 bis 32). Die Bewegung von rechts unten nach links oben – mehr Verfügbarkeit bei weniger Kosten – ist rein durch Diversifikation getrieben.

Abbildung 4: Verfügbarkeit über spezifischem CAPEX am Punkt minimaler ICR (3 MW). Jeder Punkt repräsentiert eine Verbraucher-Variante (N = 2 bis 32). Die Bewegung von rechts unten nach links oben – mehr Verfügbarkeit bei weniger Kosten – ist rein durch Diversifikation getrieben.

Kein Speicher und keine Leistungssteigerung kann das bieten. Die Abnehmerstruktur ist der günstigste Hebel im gesamten Optimierungsraum.

Ein robuster Auslegungsbereich

Natürlich ist „3 MW + 2 t" kein universelles Rezept – die exakte Konfiguration hängt von der konkreten Nachfragestruktur ab, und bei feineren Leistungsstufen könnten leichte Verschiebungen optimal sein. Aber das ist nicht der Punkt. Der Punkt ist: Im erreichbaren Konfigurationsraum existiert ein robuster Bereich, der unter allen getesteten Nachfrageszenarien stabile Kosten liefert – und dessen Verfügbarkeit mit wachsender Abnehmerbasis automatisch steigt. Die stochastische Analyse findet diesen Bereich; deterministische Planung nicht.

Für die Projektpraxis heißt das: Man muss bei der Investitionsentscheidung noch nicht genau wissen, wie viele Abnehmer es am Ende werden. Man investiert in eine Konfiguration innerhalb dieses robusten Bereichs und weiß, dass die Kosten pro Kilogramm stabil bleiben – und dass jeder zusätzliche Abnehmer die Verfügbarkeit verbessert.

Konsequenz: Die Abnehmerstruktur ist ein Designparameter

Ein Hub mit 12 kleineren Abnehmern braucht bei gleichen Kosten dramatisch weniger Speicher als einer mit 2 großen Verbrauchern – selbst wenn der Gesamtverbrauch identisch ist. Das verändert die Bewertung zentraler vs. dezentraler Versorgungskonzepte.

Und es wirft eine naheliegende Folgefrage auf: Muss die Glättung durch mehr Abnehmer entstehen – oder lässt sich derselbe Effekt durch aktive Maßnahmen bei einer gegebenen Verbraucherstruktur erzielen? Durch Lastverschiebung, koordinierte Wartungsfenster oder vorausschauende Fahrplanoptimierung ließe sich die effektive Volatilität des Bedarfsprofils reduzieren – mit denselben positiven Auswirkungen auf die Verfügbarkeit, bei unveränderter Systemauslegung. Der Diversifikationseffekt zeigt die obere Schranke: Mehr als die Verfügbarkeit der maximal diversifizierten Variante kann auch aktives Management nicht erreichen – aber er zeigt auch, wie viel Potenzial in der Glättung steckt.

Fazit: Drei Perspektiven auf Volatilität

Diese dreiteilige Analyse betrachtet dasselbe Phänomen – volatile Wasserstoffnachfrage – aus drei komplementären Perspektiven:

Teil 1: Dimensionierung. Wie legt man Erzeugungsleistung und Speicher optimal aus? Stochastisch, nicht deterministisch. Leistung vor Speicher.

Teil 2: Bewertung. Was kostet Zuverlässigkeit – und ab wann wird sie unverhältnismäßig teuer? Die ICR-Analyse zeigt exakt, wo die Grenzkosten steigen. Regime-Kosten machen den Trade-off management-tauglich.

Teil 3: Robustheit. Wie sensitiv ist die Auslegung gegenüber der Nachfragestruktur? Es gibt robuste Bereiche, die über alle Verbraucher-Varianten stabil bleiben. Diversifikation verbessert die Verfügbarkeit kostenlos.

Alle drei Perspektiven bauen auf demselben Modell auf: Markov-Ketten für die Nachfrage, Monte-Carlo für die Optimierung, Pareto-Fronten als Planungsinstrument. Das Modell wächst nicht in der Komplexität – nur in der Tiefe der Auswertung.

Ausblick: Von der Auslegung zum aktiven Management

Die hier vorgestellte Analyse beantwortet die Frage der optimalen Dimensionierung umfassend. Doch selbst bei perfekter Auslegung bleibt eine Restvariabilität – und damit Optimierungspotenzial im laufenden Betrieb. Durch intelligente Startfreigabelogik – also die gezielte Steuerung, wann ein neuer Prozess gestartet wird – ließe sich die effektive Volatilität des Bedarfsprofils weiter reduzieren, ohne in laufende Prozesse einzugreifen.

Dabei verschiebt sich die relevante Fehlermetrik: In vielen industriellen Anwendungen bedeutet eine Unterversorgung nicht nur einen verlorenen Tag, sondern den Abbruch eines laufenden Prozesses – und damit den Verlust aller bis dahin investierten Versuchstage. Diese asymmetrische Kostenstruktur erfordert eine risikogewichtete Steuerung, die den Fortschritt laufender Prozesse aktiv berücksichtigt.